计算机为何采用二进制 计算机网络技术开发的基石

计算机系统采用二进制作为其信息表示和处理的基础,这一设计选择并非偶然,而是源于其技术实现的便捷性、可靠性与逻辑一致性,并为后续计算机网络技术的发展奠定了至关重要的理论基础与物理基础。

从物理实现层面看,二进制与电子元件的特性高度契合。计算机的基本电路由数以亿计的晶体管构成,这些晶体管本质上是一种电子开关,其状态易于在“开”(通常代表高电压,逻辑值1)与“关”(通常代表低电压,逻辑值0)之间稳定、快速且可靠地切换。这种二态性直接对应了二进制的“0”和“1”。相比于模拟信号或更高进制的表示(如十进制),二进制信号的抗干扰能力强,容错率高,因为在电路噪声下,区分“高”与“低”两种状态远比区分多个不同的电压等级要简单和稳定。这使得基于二进制的数字电路设计简洁、高效且成本可控。

从逻辑运算与数学层面看,二进制与布尔代数完美对应。19世纪乔治·布尔建立的布尔代数,其变量取值仅为“真”与“假”,这恰好可以用二进制的“1”和“0”来表示。计算机中央处理器(CPU)的核心——算术逻辑单元(ALU)——所执行的所有复杂运算(加、减、乘、除、逻辑比较等),最终都可以分解为一系列基于“与”、“或”、“非”等基本逻辑门的二进制操作。这种数学上的简洁性和一致性,使得用硬件电路实现复杂的计算和控制逻辑成为可能,并确保了计算过程的绝对精确(在数字域内)。

二进制极大地简化了数据在计算机内部的存储、传输和处理。无论是数字、文本、图像、声音还是视频,所有类型的数据在计算机中最终都被编码为二进制位(bit)序列。存储设备(如内存、硬盘)通过磁化方向、电荷有无等物理方式记录“0”和“1”;处理过程则是按位对这些序列进行操作。这种统一的表示方法,为计算机体系结构的设计提供了极大的灵活性。

二进制对计算机网络技术开发的深远影响

计算机采用二进制这一根本特性,直接塑造了计算机网络技术的开发路径与核心协议:

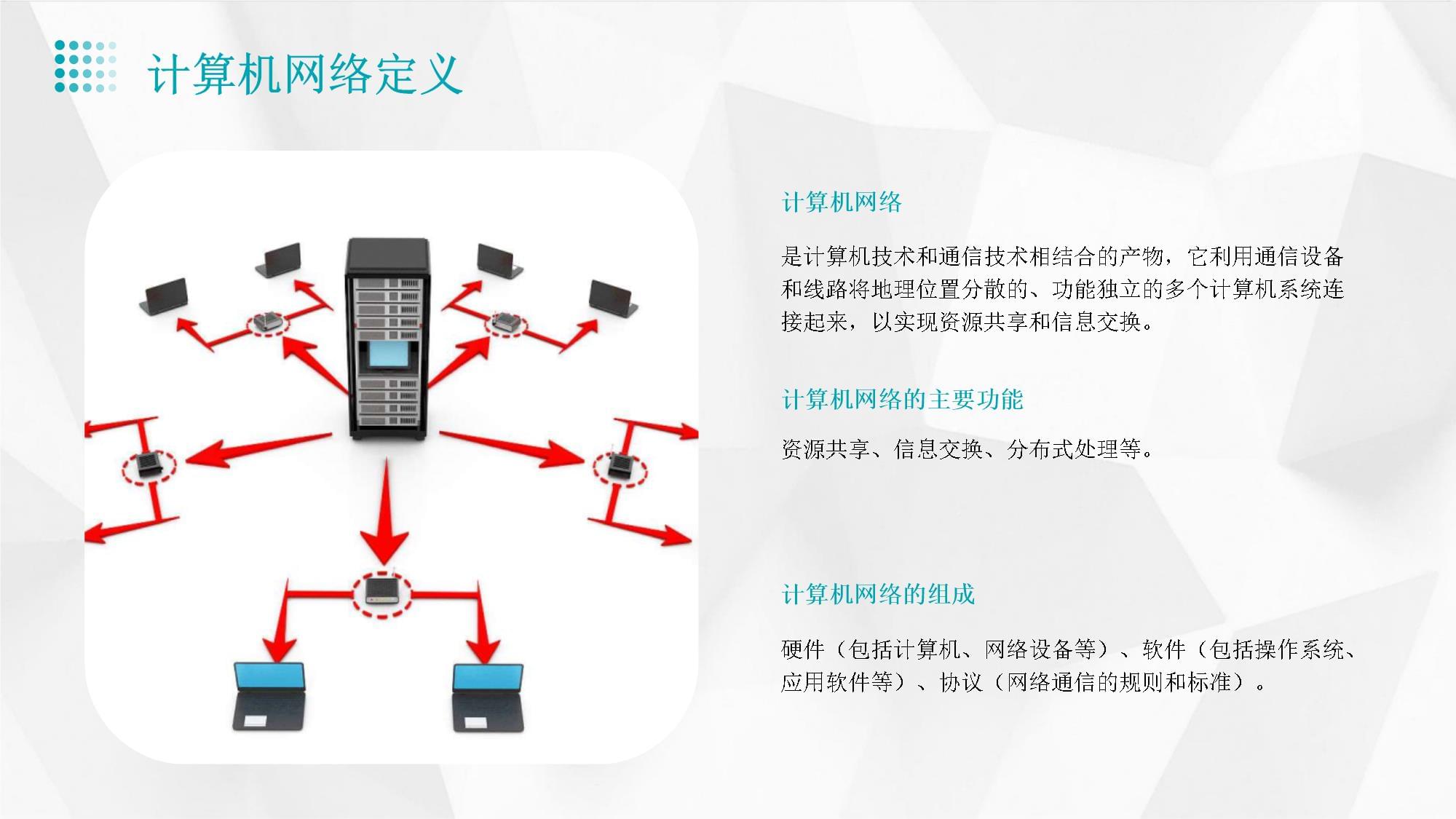

- 数据传输的基石:计算机网络传输的“数据包”,其本质就是二进制比特流。网络协议栈(如TCP/IP)的每一层,其协议头和数据载荷都以二进制格式定义。物理层负责将二进制比特转换为光、电或无线电波信号进行传输(如用不同的电压、光脉冲频率代表0和1),并在接收端准确还原。没有二进制这种简单、规范的表示法,就无法实现高效、标准化的数据编码与解码。

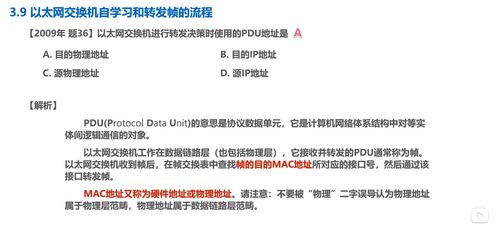

- 寻址与路由的基础:计算机网络中的关键标识,如IP地址(IPv4的32位、IPv6的128位)和MAC地址(48位),都是用二进制数字表示。路由器进行路由决策、交换机进行数据帧转发,其核心算法正是基于对这些二进制地址的匹配和查找。二进制的位操作(如与、或、移位)是高效实现子网划分、路由聚合等网络管理功能的基础。

- 协议设计与检错纠错:网络协议中大量的控制字段、状态标志位,天然地使用二进制位来表示(例如TCP报文头中的SYN、ACK、FIN等标志位)。为了保证数据传输的可靠性,网络技术广泛采用了基于二进制运算的检错码(如奇偶校验、CRC循环冗余校验)和纠错码。这些算法高效地利用了二进制位的特性来检测和修正传输过程中因干扰产生的比特错误。

- 促进了标准化与互操作性:二进制作为一种全球通用的“机器语言”,使得不同厂商、不同架构的计算机和网络设备能够相互通信。只要遵循共同的二进制协议规范,设备就能理解彼此发送的数据包含义。这是互联网能够全球互联互通的前提。

计算机采用二进制,是由其物理实现的可行性、数学逻辑的简洁性以及工程上的可靠性共同决定的。这一根本选择,不仅构成了计算机硬件的核心设计原则,也成为了计算机网络技术得以诞生和发展的“通用语”与“原子单元”。从芯片内部的微操作到横跨全球的数据传输,二进制为整个数字世界提供了统一、坚实且高效的基石。

如若转载,请注明出处:http://www.mmzz818.com/product/66.html

更新时间:2026-04-14 09:06:19